So will Apple das iPhone 12 mit einem LiDAR-Sensor revolutionieren.

MomentanEs ist sehr schwierig, ein Smartphone mit einer Kamera zu kaufen, die wir als schlecht bezeichnen können. Dies liegt daran, dass insbesondere dieser Abschnitt einer derjenigen ist, auf die Hersteller bei der Erstellung eines neuen Terminals am meisten achtenEs ist normalerweise eines der Merkmale, auf die Verbraucher beim Kauf eines neuen Geräts am meisten achten..

Dies hat dazu geführt, dass viele von uns jedes Mal mit den Augen rollen, wenn wir lesen oder hören, dass die nächste Generation des iPhone wieder über ein besseres Kamerasystem verfügen wird, wenn man bedenkt, dass das aktuelle iPhone 11 und 11 Pro eine sehr gute Leistung erbringt.

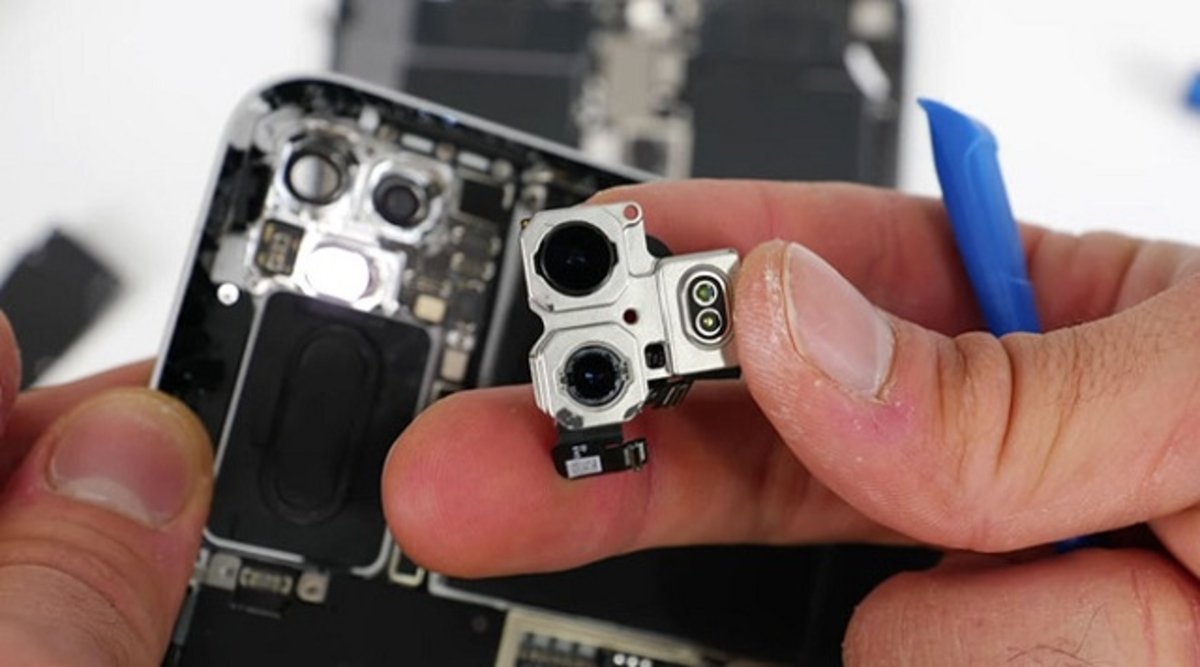

Die Wurzel dieses verbesserten Kamerasystems liegt jedoch in etwas mehr als der Qualität des Systems: Wenn die Gerüchte wahr sind, würde das nächste iPhone 12 Pro, wie das iPad Pro 2020, einen LiDAR-Sensor enthalten Satz Kameras.

Da dieser LiDAR für viele immer noch wie Chinesisch klingt, fangen wir am Anfang an, undSehen wir uns an, warum das nächste iPhone mit einem LiDAR-Sensor der Schlüssel zu dieser Technologie und dazu sein könnte, dass das iPhone seinen Konkurrenten einen Schritt voraus ist..

Was ist ein LiDAR-Sensor?

Beginnen wir mit dem Namen, und zwarLiDAR ist die Abkürzung für Light Detection and Ranging, auf Spanisch Lichterkennung und Reichweite, und definiert sehr gut, was dieser Sensor tut.

Seine Funktionsweise ist recht einfach zu verstehen: Dieser Sensor schießt und empfängt Laserstrahlen, um Objekte und Strukturen zu lokalisieren.Dank der Berechnung der Entfernung zu dem, was wir scannen, können wir vollständige Szenarien erstellen. Der Sensor sendet einen Strahl, der mit einem Objekt kollidiert und von diesem abprallt, wodurch der Strahl zurück zum Sensor gesendet wird.

Und das alles in einer unglaublichen Geschwindigkeit, sodass wir nicht einmal merken, wie es passiert, und als Antwort erhalten wir den Scan der Szene auf unseren Bildschirmen.

Diese Technologie wird seit einiger Zeit auch in anderen Bereichen wie der Luftfahrt, sowohl zu Lande als auch im Weltraum, oder bei militärischen Leitanwendungen eingesetzt.. Darüber hinaus hat diese Technologie in jüngster Zeit in vielen Haushalten Einzug gehaltendie bekannten Reinigungsroboter, die diese Sensoren nutzen, um unsere Oberflächen abzubilden und damit arbeiten zu können, oder in Autos mit autonomem Fahren, in denen sie eingesetzt werden, damit das Auto die Elemente, die es umgeben, versteht und so sicher auf den Straßen fahren kann.

Es war eine Frage der Zeit, bis diese Technologie auch unsere Smartphones erreichen würde. Da diese zunehmend über eine höhere Rechenleistung verfügen, ist es nicht verwunderlich, dass sie diese nun nutzen wollen, indem sie LiDAR-Sensoren in ihre Kamerasysteme integrieren.

Warum ein LiDAR-Sensor in einem Smartphone?

Obwohl es sich um LiDAR-Sensoren handelt, wird seit einigen Jahren eine etwas einfachere Technologie in Smartphones verwendetlos sensores ToF o „Time of Flight“. Diese SensorenSie arbeiten mit Infrarotlicht ähnlich wie LiDAR, jedoch mit einer einzigen Lichtemission, und sie berechnen die Tiefe einer Szene, indem sie die Zeit berechnen, die der Strahl brauchte, um zu dem von uns gescannten Objekt hin und her zu gelangen.

Also,Warum LiDAR auf dem iPad Pro und iPhone 12 Pro verwenden? LiDAR-Sensoren ermöglichen ein viel schnelleres Scannen als ToF-Sensoren, da sie mehrere Laserstrahlen zum Zusammenstellen der Szene verwenden und dadurch mehr Objekte erkennen und mehr Informationen sammeln könnenals diese. In der Praxis führt dies zu einer besseren Tiefenerkennung, wenn wir beispielsweise ein Objekt vor einem anderen haben, und erleichtert dem LiDAR-Scanner die Erstellung reichhaltigerer und detaillierterer Umgebungen.

Darüber hinaus natürlichDiese Technologie kann in Verbindung mit den Kameras unserer Smartphones verwendet werden, um Fotos mit Tiefenwirkung und Bokeh-Effekt zu erzielen.. Den LiDAR-Sensor des einzigen Geräts, das über einen solchen verfügt, wollte Apple hierfür allerdings nicht nutzenBeim iPad Pro ist die Verwendung des Porträtmodus mit der Rückkamera nicht möglich, und hat es vorgezogen, sich auf den Einsatz in Augmented-Reality-Apps zu konzentrieren, ein Segment, auf das die Unternehmen aus Cupertino sehr stark setzen. Dank dessen verfügen wir über Anwendungen, mit denen dieser Sensor sehr gut funktioniert, wie zum Beispiel IKEA Place, mit dem wir Möbel aus dem berühmten Geschäft in unseren Häusern platzieren können, um zu sehen, wie sie passen.

Leider weist die LiDAR-Kamera des iPad Pro einige Einschränkungen auf. Unter diesen fehlt am meisten eine API, die es ermöglicht, die von LiDAR erfassten Informationen zu extrahieren, um sie beispielsweise als 3D-Objekte zu exportieren.

Apple verfügt über ARKit, das eine Augmented-Reality-App-Entwicklungsumgebung für seine Geräte bietet, obwohl es derzeit den Anschein hat, dass diese Apps nicht ganz attraktiv sind.

Youtube /EverythingApplePro

LiDAR auf dem iPhone 12 Pro

Das Spiel vonDie Installation eines LiDAR-Sensors auf dem iPhone 12 Pro ist eine Wette für die Zukunft. Heutzutage bieten Augmented-Reality-Apps ein mittelmäßiges Erlebnis, das nicht ganz bezaubernd ist, und das kann sich dank des verbesserten Erlebnisses, das dieser Sensor bieten würde, völlig ändern. Aber wie wird Apple die Entwicklung weiterer AR-Apps fördern?

Wenn wir Millionen und Abermillionen von iPhones pro Jahr verkaufen, gibt es keinen besseren Weg, Entwickler zur Entwicklung von Augmented-Reality-Apps zu ermutigen, als einen Sensor in unsere iPhones zu integrieren, der das Beste aus dieser Technologie herausholt?

Apple möchte den Trick ausspielen, dass die Entwickler, da das iPhone über diese Technologie verfügen wird, sich letztendlich dazu entschließen, sie auch zu nutzen. Wenn Millionen von Benutzern einen LiDAR-Scanner in der Tasche haben, warum sollten sie ihn dann nicht verwenden?

Kurzfristig wird der Start dieser Technologie viele weitere Apps wie IKEA Place zur Vermessung von Räumen und Simulation von Umgebungen und möglicherweise ein besseres Erlebnis im Bereich mobiler Spiele mit AR bedeuten. Jedoch,Langfristig kann der Einsatz dieser Technologie zu vielen kreativen Anwendungen und Diensten führen, die dem, was dieser Scanner zu bieten hat, endlich gerecht werden.

Und die Konkurrenz?

Das nächste Flaggschiff, das wir in den Regalen sehen werden, wird wahrscheinlich das Samsung Galaxy Note 20 sein, das voraussichtlich über ein sehr ähnliches (wenn nicht sogar dasselbe) Kamerasystem wie das bereits im aktuellen Galaxy S20 Ultra verbaute verfügt. Wenn ja, würde ich weiterhin einen ToF-Sensor anstelle eines LiDAR-Scanners implementieren, was der Fall wäreDamit wäre Apple der einzige Hersteller mit einem LiDAR-Sensor in einem Smartphone auf dem Markt und damit der einzige, der in der Lage wäre, das bestmögliche Erlebnis in der Augmented Reality zu bieten.Nutzung eines Systems mit viel mehr Auflösung und Potenzial.

NatürlichDas sind alles reine Spekulationen und Gerüchte., und schließlich könnte das iPhone 12 Pro am Ende ein viertes Objektiv in sein Rückkamerasystem einbauen und diesen Sensor beiseite lassen. JedochApple ist normalerweise ein Vorreiter beim Einsatz solcher Technologien, sodass ein LiDAR-Scanner perfekt in ein iPhone 12 Pro passt, das als Rammbock dafür dienen würde, dass diese Technologie Teil unseres täglichen Lebens wird.

Du kannst folgeniPadisiertInFacebook,WhatsApp,Twitter (X)konsultieren oder konsultierenunser Telegram-Kanalum über die neuesten Technologienachrichten auf dem Laufenden zu bleiben.